Was der EU AI Act ist — und was er nicht ist

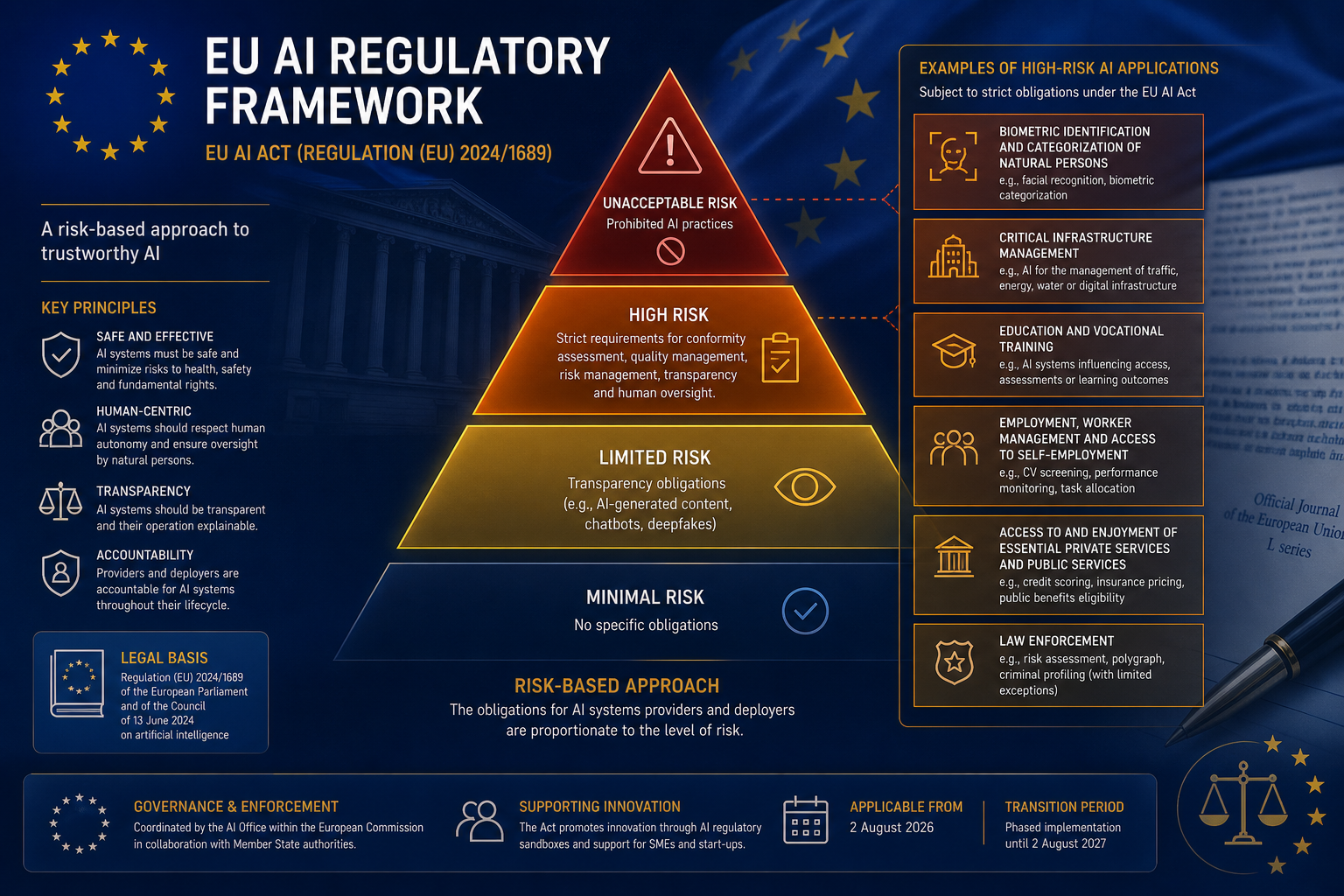

Der EU AI Act (Verordnung (EU) 2024/1689) ist die weltweit erste umfassende gesetzliche Regulierung von Künstlicher Intelligenz. Er wurde im August 2024 in Kraft gesetzt und wird schrittweise wirksam: Die Verbote für bestimmte KI-Praktiken (Art. 5) galten ab Februar 2025, die Anforderungen für General-Purpose-AI-Modelle ab August 2025 — und die vollständigen Hochrisiko-Anforderungen gelten ab 2. August 2026.

Was der EU AI Act nicht ist: ein pauschales Verbot oder eine Innovationsbremse für alle KI-Anwendungen. Der Großteil der KI-Anwendungen in deutschen Unternehmen fällt in die Kategorie 'minimales Risiko' oder 'limitiertes Risiko' — mit überschaubaren Anforderungen. Der strenge Teil des Gesetzes trifft Systeme, die in spezifischen Hochrisiko-Bereichen eingesetzt werden: Personalentscheidungen, Kreditvergabe, kritische Infrastruktur.

Die praktische Frage für jeden Unternehmer ist daher nicht 'Wie reguliert der EU AI Act KI allgemein?', sondern: 'Fällt irgendeines meiner KI-Systeme in eine Hochrisiko-Kategorie?' Die Antwort bestimmt den gesamten Compliance-Aufwand.

- In Kraft seit August 2024, vollständige Hochrisiko-Anforderungen ab 2. August 2026

- Risikobasierter Ansatz: nicht alle KI-Anwendungen gleich reguliert

- Die meisten B2B-Standardanwendungen: minimales oder limitiertes Risiko

- Höchststrafe: 35 Mio. € oder 7 % Jahresumsatz für verbotene KI

Die vier Risikoklassen: Wo Ihr System einzuordnen ist

Verbotene KI (Art. 5): Seit Februar 2025 verboten. Dazu gehören Social-Scoring-Systeme, die Menschen anhand sozialen Verhaltens bewerten; KI zur unbewussten Manipulation des Verhaltens von Personen; Echtzeit-Biometrie in öffentlichen Räumen (mit engen Ausnahmen für Strafverfolgung); KI zur Ausnutzung von Schwächen vulnerabler Gruppen.

Hochrisiko-KI (Anhang III): Strenge Anforderungen ab August 2026. Betrifft: KI in kritischer Infrastruktur, Bildung, Beschäftigung und Personalmanagement, wesentliche Dienstleistungen (Kredite, Versicherungen), Strafverfolgung, Migration, Rechtspflege. Für jede dieser Kategorien gibt es spezifische Anforderungen: technische Dokumentation, Konformitätsbewertung, Logging, menschliche Aufsicht.

Limitiertes Risiko: Chatbots, KI-generierte Inhalte, Deep-Fake-Technologien. Hauptanforderung: Transparenz gegenüber Nutzern. Wenn Ihr Unternehmen einen KI-Chatbot betreibt, müssen Nutzer wissen, dass sie mit KI kommunizieren. Das ist machbar und für die meisten Unternehmen der einzige EUAIA-Aufwand.

Minimales Risiko: Spam-Filter, KI in Videospielen, KI für Produktionsoptimierung ohne direkte Entscheidungswirkung auf Menschen. Keine besonderen Anforderungen.

- Verbotene KI (Art. 5): sofortige Pflicht zur Abschaltung, seit Februar 2025

- Hochrisiko (Anhang III): vollständige Anforderungen ab 2. August 2026

- Limitiertes Risiko: Transparenzpflicht — KI muss als solche erkennbar sein

- Minimales Risiko: keine besonderen Anforderungen

Hochrisiko-KI im Detail: Wer ist wirklich betroffen?

Anhang III listet acht Kategorien auf. Für deutschen B2B-Mittelstand sind drei relevant: Kategorie 1 (kritische Infrastruktur — relevant für Energie, Wasser, Transport), Kategorie 4 (Beschäftigung und Personalmanagement — betrifft nahezu jedes Unternehmen, das HR-KI einsetzt) und Kategorie 5 (wesentliche Dienstleistungen — relevant für Banken, Versicherungen, öffentliche Dienstleistungserbringer).

Kategorie 4 verdient besondere Aufmerksamkeit: Sie umfasst KI-Systeme für Recruitment, Leistungsbewertung, Mitarbeiterüberwachung und Beförderungsentscheidungen. Wer ein KI-Tool einsetzt, das Bewerbungen vorselektiert, Leistungsdaten analysiert oder automatisiert Bewertungen erzeugt, ist mit hoher Wahrscheinlichkeit im Hochrisiko-Bereich.

Wichtige Nuance: Der Anwendungskontext entscheidet. Ein allgemeines LLM (GPT-4o, Llama 4) ist keine Hochrisiko-KI. Wenn dasselbe LLM in einem HR-Tool eingesetzt wird, das Bewerbungsunterlagen bewertet und Rankings erstellt, ist der Einsatz hochriskant — und Sie als Betreiber tragen die Compliance-Verantwortung, auch wenn das Modell von einem Drittanbieter stammt.

- HR-KI: automatisiertes Screening, Leistungsbewertung, Mitarbeitermonitoring = Hochrisiko

- Kreditvergabe-KI: automatisierte Bonitätsbewertung = Hochrisiko

- Allgemeine LLMs sind per se kein Hochrisiko — der Einsatzkontext entscheidet

- Als Betreiber tragen Sie Compliance-Verantwortung, auch bei Drittanbieter-KI

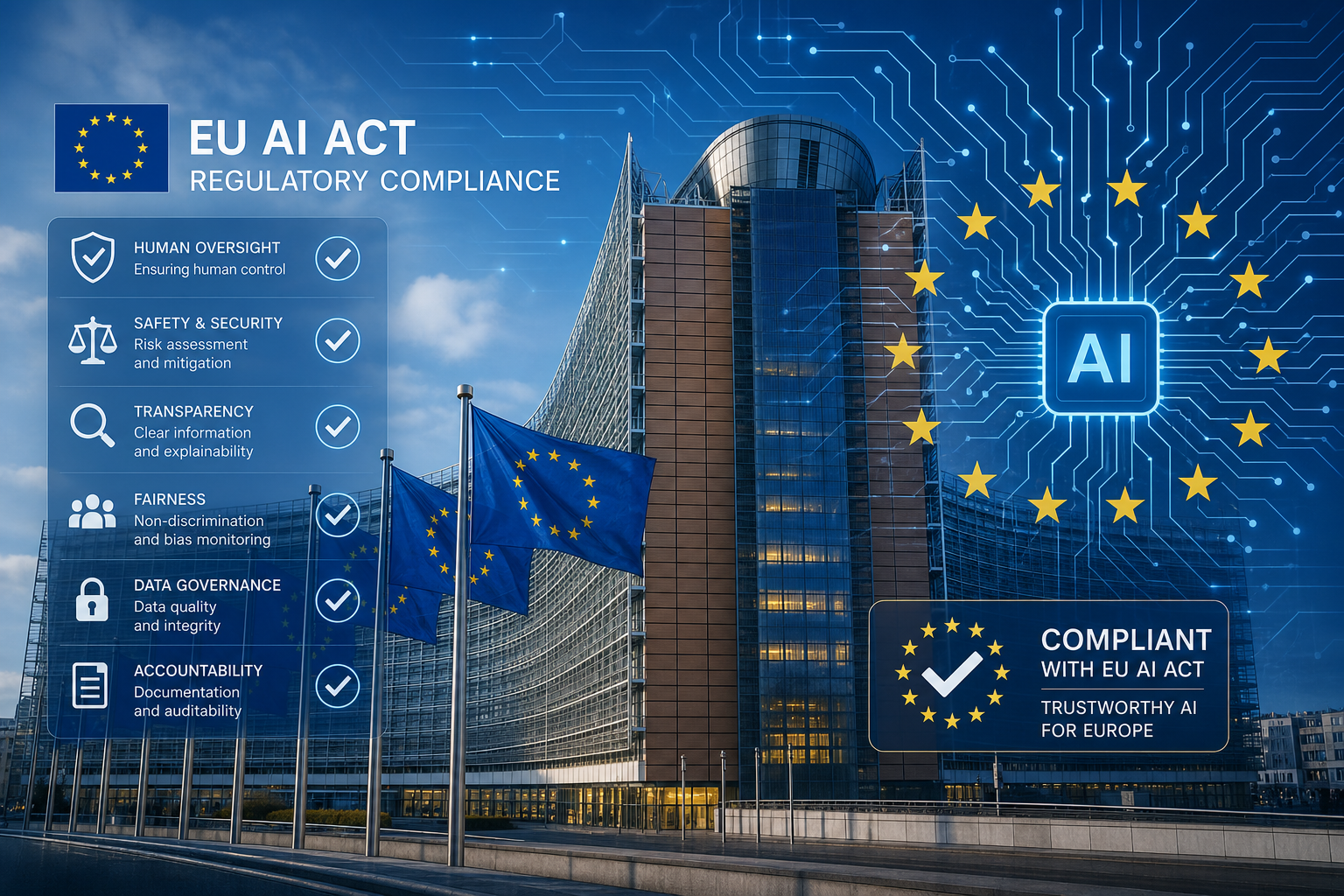

Was Hochrisiko-Systeme konkret voraussetzen

Technische Dokumentation (Anhang IV): Eine vollständige Beschreibung des Systems — Zweck, Architektur, Trainingsdaten, Performance-Metriken, bekannte Limitierungen und Risiken. Diese Dokumentation muss aktuell gehalten werden und bei Behördenanfragen vorgelegt werden können.

Konformitätsbewertung: Für die meisten Hochrisiko-Systeme: Selbstbewertung nach den harmonisierten Normen. Für bestimmte Kategorien (biometrische Identifikation, kritische Infrastruktur): externe Notified Body. Nach erfolgreicher Bewertung: CE-Kennzeichnung.

Logging-Pflicht: Das System muss automatisch Logs generieren, die die Rückverfolgbarkeit von Entscheidungen ermöglichen. Zeitstempel, relevante Inputs, Outputs, Konfiguration zum Zeitpunkt der Entscheidung.

Menschliche Aufsicht: Das System muss so gestaltet sein, dass Menschen Entscheidungen überprüfen, korrigieren und das System stoppen können. Vollautomatische irrevere Entscheidungen sind nicht zulässig.

Registrierung: Hochrisiko-Systeme müssen in der EU-KI-Datenbank registriert werden.

- Technische Dokumentation (Anhang IV): vollständig vor dem Go-Live

- Konformitätsbewertung: Selbstbewertung oder externe Notified Body je nach Kategorie

- Automatisches Logging: Zeitstempel, Inputs, Outputs für jede Entscheidung

- Human-Override: jede Entscheidung muss durch Menschen überschreibbar sein

- EU-KI-Datenbank: Registrierungspflicht für Hochrisiko-Systeme

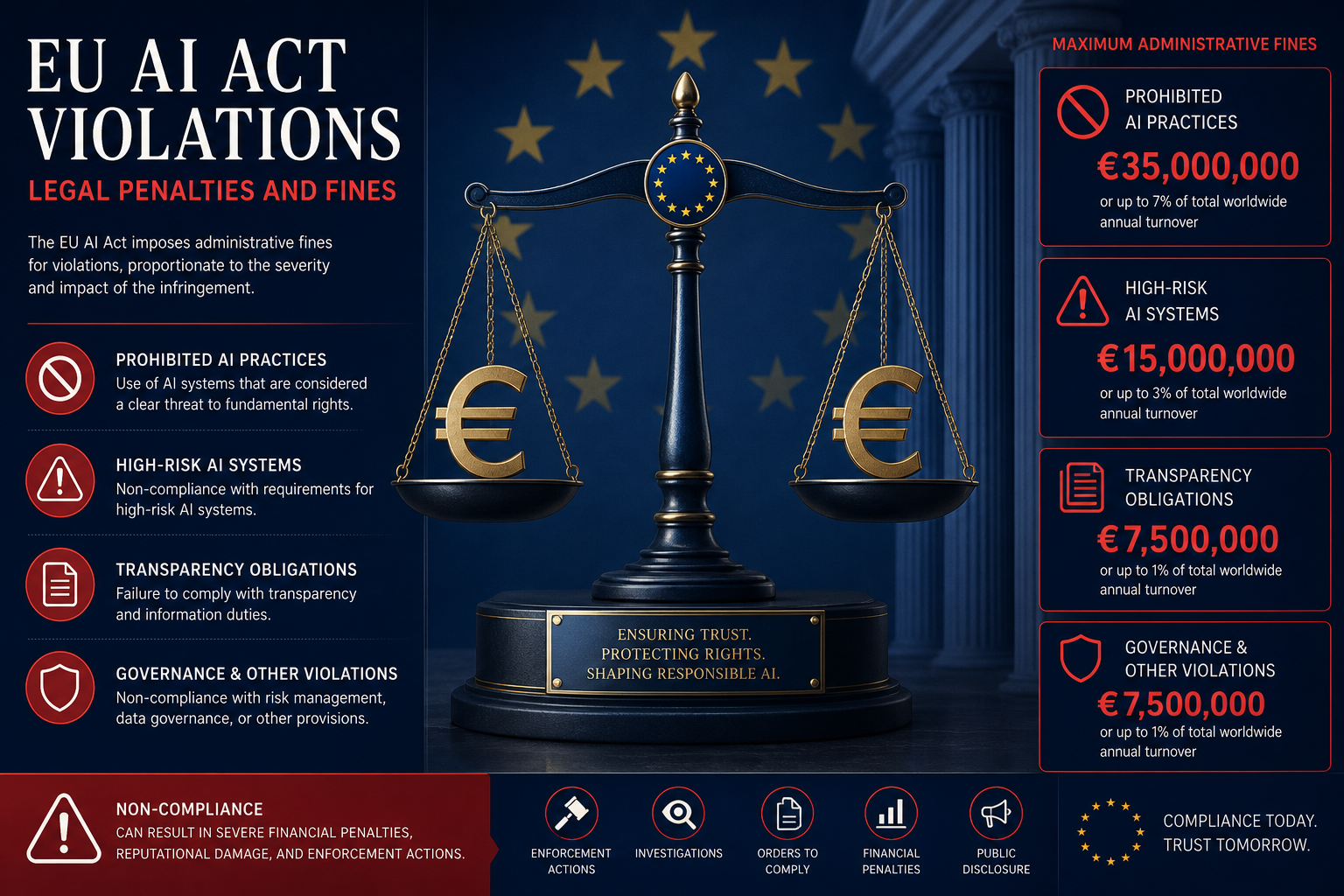

Bußgelder und Durchsetzung: Das realistische Risiko

Der EUAIA sieht drei Bußgeld-Stufen vor: Bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes für verbotene KI (Art. 5). Bis zu 15 Millionen Euro oder 3 % für Hochrisiko-Verstöße (fehlende Dokumentation, fehlende Konformitätsbewertung, Logging-Defizite). Bis zu 7,5 Millionen Euro oder 1,5 % für falsche Angaben gegenüber Behörden.

Die Bundesnetzagentur ist die primäre Marktüberwachungsbehörde in Deutschland. Sektorbehörden (BaFin für Finanzdienstleistungen, BSI für Cybersicherheitsaspekte) bleiben in ihren Bereichen zuständig.

Realistisches Szenario für die Anfangsphase: Behörden werden primär auf Beschwerden reagieren und bei ersten Verstößen Abhilfefristen einräumen, bevor Bußgelder verhängt werden. Der Zeitpunkt, Compliance-Defizite zu korrigieren, ist jetzt — vor August 2026, nicht nach einem Behördenbesuch.

- Stufe 1 (verbotene KI): 35 Mio. € / 7 % Jahresumsatz

- Stufe 2 (Hochrisiko-Verstöße): 15 Mio. € / 3 % Jahresumsatz

- Bundesnetzagentur als primäre Durchsetzungsbehörde in Deutschland

- KMU: reduzierte Bußgelder möglich, aber keine Befreiung von Pflichten

DSGVO und EU AI Act: Beide gleichzeitig erfüllen

Ein häufiges Missverständnis: DSGVO-Konformität impliziert EUAIA-Konformität. Das stimmt nicht. Beide Regelwerke regulieren unterschiedliche Aspekte: Die DSGVO schützt personenbezogene Daten, der EUAIA regelt Systemeigenschaften von KI — unabhängig davon, ob personenbezogene Daten verarbeitet werden.

Wo sich beide überschneiden: KI-Systeme, die personenbezogene Daten verarbeiten und in eine Hochrisiko-Kategorie fallen. Hier sind beide Regelwerke parallel zu erfüllen. Die DSGVO-Anforderungen (Rechtsgrundlage, Datenminimiierung, Auskunftsrecht) und die EUAIA-Anforderungen (technische Dokumentation, Logging, Human Override) ergänzen sich, ersetzen sich aber nicht.

Praktischer Tipp: Wenn Sie bereits ein solides DSGVO-Verarbeitungsverzeichnis haben, ergänzen Sie es um EUAIA-spezifische Felder. Dasselbe KI-Inventar, dieselbe Review-Struktur — aber mit EUAIA-Risikoklassifikation und Konformitätsstatus als zusätzliche Spalten.

- DSGVO = Datenschutz; EUAIA = Systemeigenschaften — beides separat prüfen

- Überschneidung bei KI mit personenbezogenen Daten in Hochrisiko-Kontext

- DSGVO Art. 22 (automatisierte Entscheidungen) als konzeptionelle Basis nutzen

- DSGVO-Verarbeitungsverzeichnis um EUAIA-Felder ergänzen — doppelter Aufwand vermeiden

Compliance-Roadmap: Was jetzt zu tun ist

Sofort (Mai–Juli 2026): KI-Inventar erstellen. Alle KI-Systeme, -Tools und -Funktionen in eingekaufter Software erfassen. Für jedes System: Zweck, betroffene Personengruppen, Entscheidungsrelevanz. Risikoklassifikation nach Anhang III durchführen.

Bis August 2026: Für alle identifizierten Hochrisiko-Systeme: Technische Dokumentation erstellen, Logging-Infrastruktur sicherstellen, Human-Override-Prozesse dokumentieren und testen. Transparenzhinweise für Chatbots und KI-generierte Inhalte implementieren.

Laufend ab August 2026: Konformitätsbewertungen bei Systemänderungen wiederholen. Registrierung in der EU-KI-Datenbank vornehmen. Drittanbieter-KI auf Konformitätsnachweise prüfen. Mitarbeiter schulen.

- Schritt 1: KI-Inventar — jetzt, vor allen anderen Maßnahmen

- Schritt 2: Risikoklassifikation — Anhang III Punkt für Punkt prüfen

- Schritt 3: Hochrisiko-Dokumentation, Logging, Human Override bis August 2026

- Laufend: Drittanbieter-Compliance prüfen, Mitarbeiter informieren