Die drei Bußgeld-Stufen im Überblick

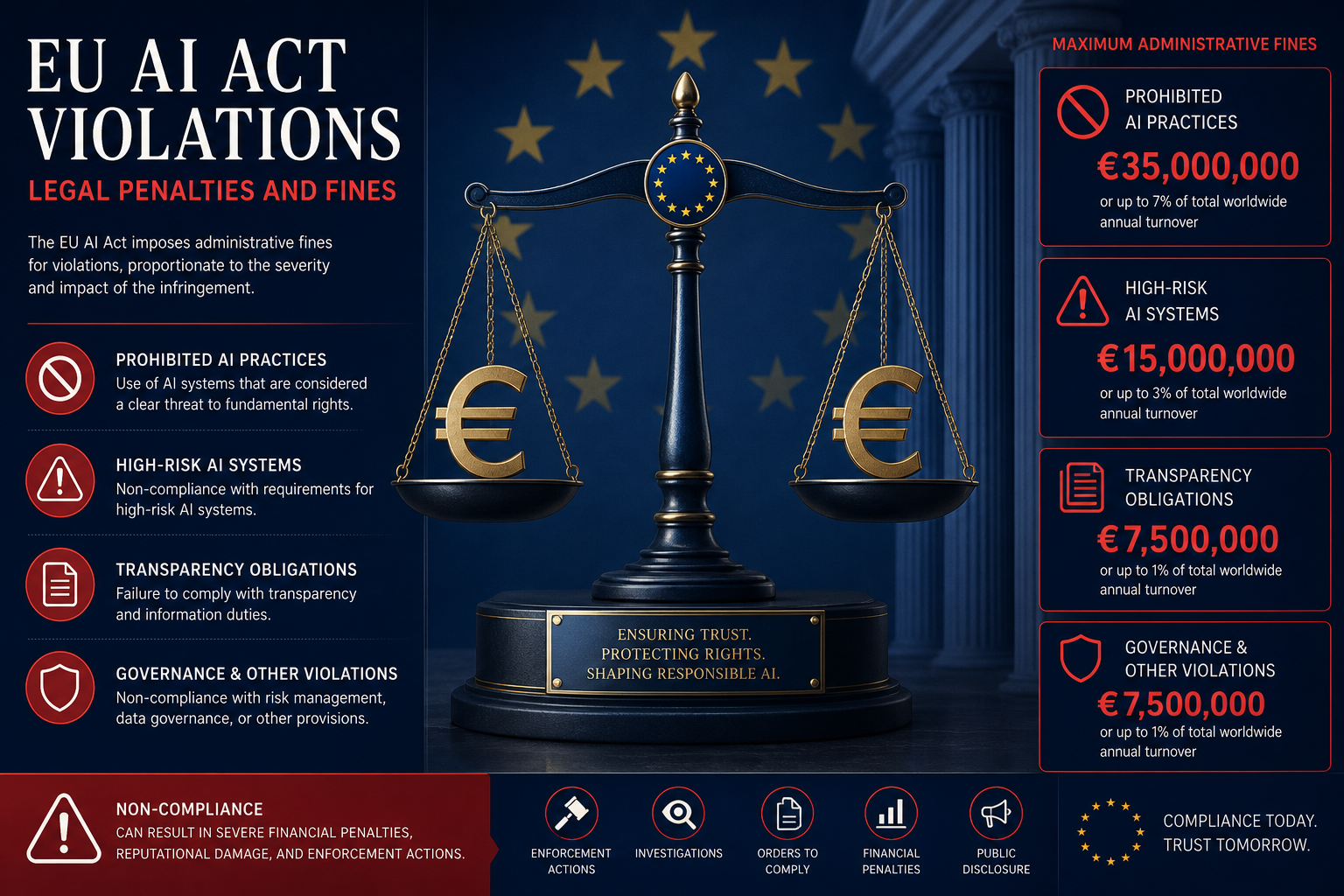

Stufe 1 — Verbotene KI (Art. 5):

Bis zu 35 Millionen Euro oder 7 % des weltweiten Jahresumsatzes, je nachdem welcher Betrag höher ist. Diese Stufe trifft Unternehmen, die ein ausdrücklich verbotenes KI-System betreiben: Social Scoring, manipulative KI, Echtzeit-Biometrie ohne Ausnahmetatbestand, KI zur Ausnutzung vulnerabler Gruppen.

Stufe 2 — Hochrisiko-Verstöße:

Bis zu 15 Millionen Euro oder 3 % des weltweiten Jahresumsatzes. Diese Stufe betrifft Unternehmen, die Hochrisiko-KI ohne die vorgeschriebene Konformitätsbewertung, ohne technische Dokumentation oder ohne die Logging-Anforderungen betreiben.

Stufe 3 — Irreführende Angaben:

Bis zu 7,5 Millionen Euro oder 1,5 % des weltweiten Jahresumsatzes. Betrifft falsche oder irreführende Angaben gegenüber Marktüberwachungsbehörden oder Notified Bodies.

Wer kontrolliert? Die Marktüberwachungsstruktur

Jeder EU-Mitgliedstaat benennt eine Marktüberwachungsbehörde. In Deutschland übernimmt die Bundesnetzagentur diese Rolle für allgemeine KI-Systeme; sektorspezifische Behörden (BaFin, Bundesamt für Sicherheit in der Informationstechnik) bleiben für ihren Bereich zuständig.

Auf EU-Ebene gibt es das AI Office der Europäischen Kommission, das insbesondere General-Purpose-AI-Modelle (GPT-Klasse) überwacht.

Wie wahrscheinlich sind Kontrollen? Die DSGVO-Erfahrung zeigt: Zu Beginn primär bei prominenten Verstößen und auf Beschwerden hin. Aber der EU AI Act enthält aktive Marktüberwachungsrechte — Behörden dürfen Unternehmen direkt auffordern, Dokumentation vorzulegen und Zugang zu Systemen zu gewähren.

Wer zahlt wirklich? Die praktische Risikoabschätzung

Drei Szenarien, die ich für realistisch halte:

Szenario 1 — Großer Konzern, eindeutiger Verstoß: Ein MDAX-Unternehmen betreibt ein KI-gestütztes Bewerber-Screening-Tool (Anhang III, Kategorie 4) ohne Konformitätsbewertung und Logging. Behörde prüft nach Mitarbeiterbeschwerde. Stufe-2-Bußgeld, verhandelt auf 2–5 % Jahresumsatz. Realistisch.

Szenario 2 — Mittelstand, fahrlässige Unkenntnis: Unternehmen nutzt KI-HR-Tool eines Drittanbieters, der Anbieter kommuniziert EUAIA-Anforderungen nicht klar. Erstprüfung endet mit Abhilfefrist, kein Bußgeld. Realistisch — zumindest in der Anfangsphase.

Szenario 3 — Startup, keine verbotene KI: Startup baut KI-Chatbot für Kundensupport. Keine Hochrisiko-Klassifikation. Einzige Pflicht: Transparenzhinweis "Sie kommunizieren mit einem KI-System". Kein Bußgeldrisiko bei Einhaltung.

KMU und Startups: Privilegiert, aber nicht ausgenommen

Art. 99 enthält Erleichterungen für KMU und Startups: Behörden sollen bei der Bemessung von Bußgeldern "wirtschaftliche Tragfähigkeit" berücksichtigen. Die Pflichten selbst — Konformitätsbewertung, Dokumentation, Logging — gelten aber unverändert auch für kleine Unternehmen.

Konkret bedeutet das: Ein 20-Personen-Startup, das ein Hochrisiko-System betreibt, muss dieselbe technische Dokumentation erstellen wie ein Konzern. Das Bußgeld bei Verstoß kann aber geringer ausfallen.

Was jetzt zu tun ist

Für die meisten B2B-Unternehmen gilt: Das realistische Risiko liegt nicht in Stufe 1 (verbotene KI), sondern in Stufe 2 (Hochrisiko ohne Compliance). Und das lässt sich mit strukturiertem Vorgehen vermeiden.

Priorität 1: Inventar aller KI-Systeme erstellen und Risikoklassifikation durchführen.

Priorität 2: Für alle Hochrisiko-Systeme: Konformitätsbewertung initiieren, technische Dokumentation starten.

Priorität 3: Drittanbieter-KI prüfen — sind Ihre eingekauften Softwareprodukte EUAIA-konform? Deren Konformität ist nicht automatisch Ihre.

---

Vollständiger EU AI Act Leitfaden: Hochrisiko-Klassifikation, Compliance-Checkliste und Umsetzungsschritte: EU AI Act: Der Praxis-Leitfaden für deutsche Unternehmen