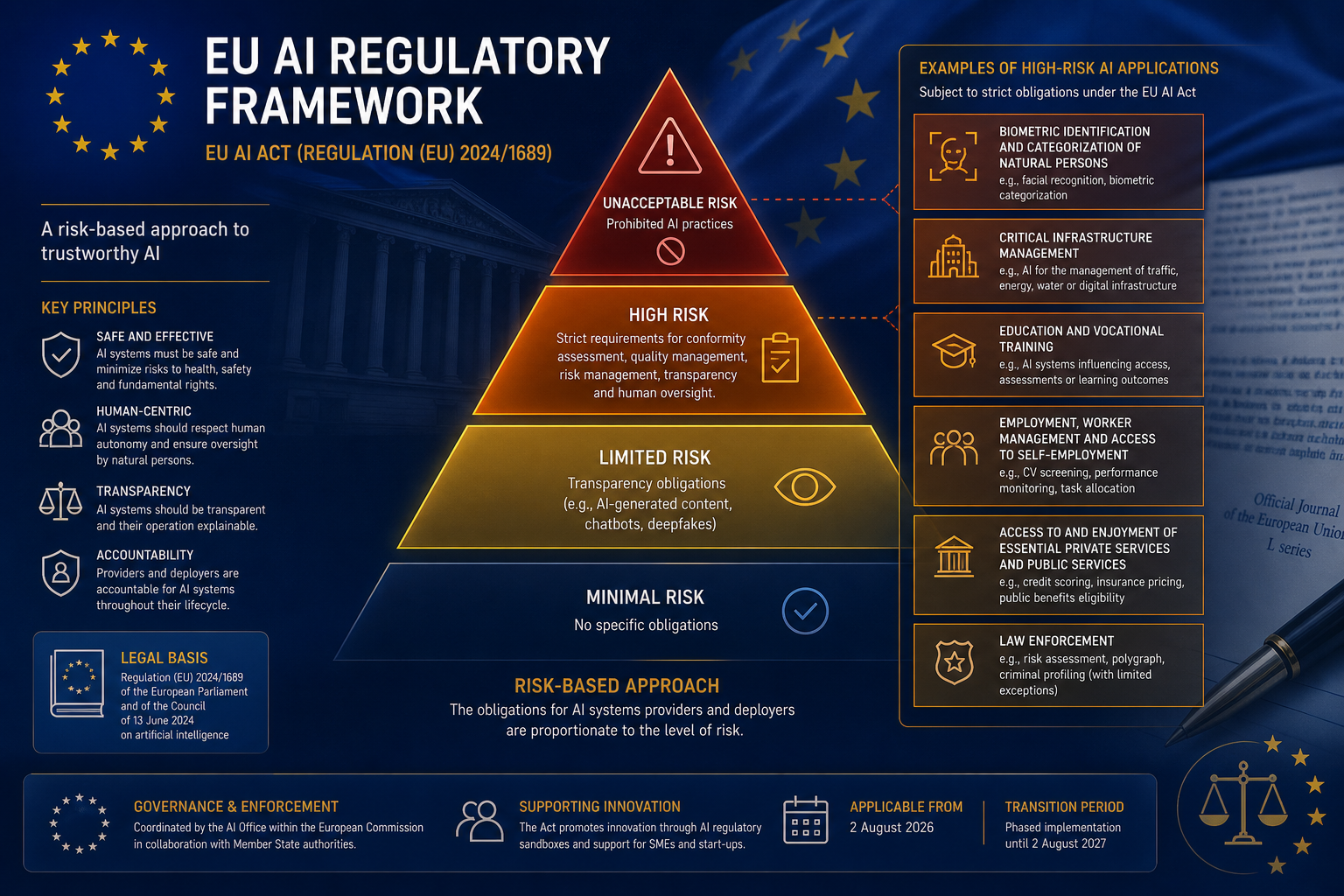

Die vier Risikoklassen des EU AI Act

Der EU AI Act teilt KI-Systeme in vier Kategorien ein:

Verbotene KI (Art. 5): Diese Systeme dürfen ab sofort nicht mehr betrieben werden. Dazu gehören: Social-Scoring-Systeme, die Menschen aufgrund sozialen Verhaltens bewerten; KI zur Echtzeitüberwachung in öffentlichen Räumen mit biometrischer Identifikation (mit engen Ausnahmen für Strafverfolgung); KI, die unbewusst das Verhalten von Menschen manipuliert; KI zur Ausnutzung von Schwächen vulnerabler Gruppen.

Hochrisiko-KI (Anhang III): Hier liegt der Fokus für B2B-Unternehmen. Strenge Anforderungen, aber keine Verbote.

Limitierte Risiko-KI: Chatbots und ähnliche Systeme mit Transparenzpflichten (Nutzer müssen wissen, dass sie mit KI kommunizieren).

Minimales Risiko: Spam-Filter, KI in Videospielen — keine besonderen Anforderungen.

Was konkret als Hochrisiko gilt: Anhang III im Detail

Anhang III listet die Hochrisiko-Bereiche auf. Für B2B-Unternehmen besonders relevant:

Kategorie 4 — Beschäftigung und Personalmanagement:

KI-gestützte Recruiting-Tools zur Bewerberselektion, Leistungsbewertungssysteme, Systeme zur Überwachung von Mitarbeitern, KI-gestützte Beförderungsentscheidungen. Das ist die Kategorie, in die die meisten B2B-HR-KI-Anwendungen fallen.

Kategorie 5 — Zugang zu wesentlichen Dienstleistungen:

KI-gestützte Kreditwürdigkeitsprüfungen, Versicherungsrisikobewertungen, Notfallmaßnahmen-Priorisierung. Relevant für Fintech- und InsurTech-Unternehmen.

Kategorie 6 — Strafverfolgung: Weitgehend irrelevant für normale B2B-Unternehmen.

Kategorie 7 — Migration und Asyl: Irrelevant für die meisten B2B-Unternehmen.

Kategorie 8 — Rechtspflege: KI für Gerichtsurteile, Strafzumessung. Relevant für Legal-Tech.

Was Hochrisiko-KI konkret vorausetzt

Wenn Ihr System in eine Hochrisiko-Kategorie fällt, müssen Sie ab 2. August 2026 folgende Anforderungen erfüllen:

Technische Dokumentation (Anhang IV): Vollständige Beschreibung des Systems — Trainingsdaten, Architektur, Performance-Metriken, bekannte Limitierungen. Kein Marketingdokument, sondern technische Substanz.

Konformitätsbewertung: Für die meisten Hochrisiko-Systeme: Selbstbewertung nach harmonisierten Normen. Für Biometrie und kritische Infrastruktur: externe Notified Body.

Logging-Pflicht: Das System muss automatisch Logs generieren, die Rückverfolgbarkeit ermöglichen. Eingaben, Ausgaben, Zeitstempel, relevante Parameter.

Menschliche Aufsicht: Das System muss so gestaltet sein, dass Menschen eingreifen, korrigieren und notfalls abschalten können. Vollautomatische Entscheidungen ohne menschliche Überprüfungsmöglichkeit sind nicht zulässig.

Registrierungspflicht: Hochrisiko-Systeme müssen in der EU-Datenbank (EUDAMED-Äquivalent für KI) registriert werden.

Was die meisten Unternehmen unterschätzen: Der Verwendungskontext entscheidet

Ein KI-System ist nicht per se Hochrisiko. Der Kontext entscheidet. Ein Textgenerator, der Marketing-E-Mails schreibt: kein Hochrisiko. Derselbe Textgenerator, der automatisch Ablehnungsbescheide für Kreditanträge formuliert: Hochrisiko.

Das hat eine praktische Konsequenz: Allgemein verfügbare KI-Tools (ChatGPT, Copilot) werden zu Hochrisiko-Systemen, wenn sie von Ihrem Unternehmen in einem Hochrisiko-Kontext eingesetzt werden. Der Anbieter liefert das Werkzeug, aber Ihr Unternehmen ist als "Betreiber" für die EUAIA-Konformität des Einsatzes verantwortlich.

Der erste Schritt: KI-Inventar erstellen

Bevor Sie Compliance-Maßnahmen starten, brauchen Sie ein vollständiges Inventar aller KI-Systeme, die in Ihrem Unternehmen eingesetzt werden — inklusive der eingekauften Drittanbieter-Tools.

Für jedes System klären Sie:

Meine Erfahrung: Dieses Inventar existiert in den meisten Unternehmen nicht. Die Erstellung dauert typischerweise zwei bis vier Wochen und ist der unverzichtbare erste Schritt.

---

Vollständige EU AI Act Compliance-Strategie: Checklisten, Strafen, DSGVO-Zusammenhang und Compliance-by-Design für Entwickler im Leitfaden: EU AI Act: Der Praxis-Leitfaden für deutsche Unternehmen

- Was entscheidet oder empfiehlt das System?

- Wen betrifft die Entscheidung (Mitarbeiter, Kunden, Dritte)?

- Fällt der Anwendungsfall in eine Anhang-III-Kategorie?

- Wer ist rechtlich verantwortlich — Ihr Unternehmen als Betreiber, oder der Anbieter?