Was Private AI bedeutet — und was es nicht bedeutet

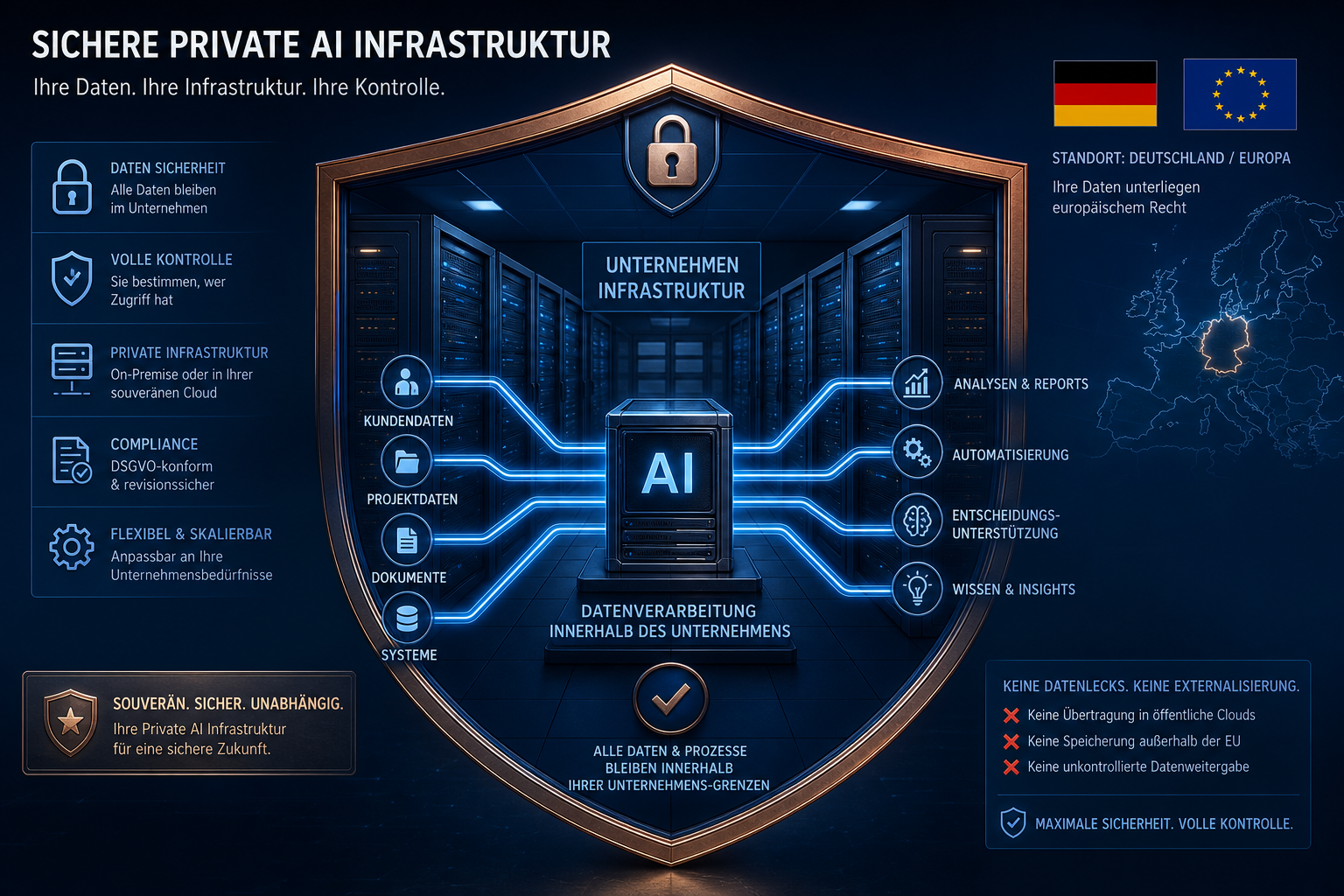

Private AI bezeichnet KI-Systeme, die auf eigener Infrastruktur oder zertifizierten EU-Servern betrieben werden — ohne dass Anfragen, Daten oder Ergebnisse an externe Anbieter wie OpenAI, Anthropic oder Google übermittelt werden. Das Modell läuft lokal oder in einer kontrollierten Umgebung. Die Daten bleiben wo sie hingehören: im Unternehmen.

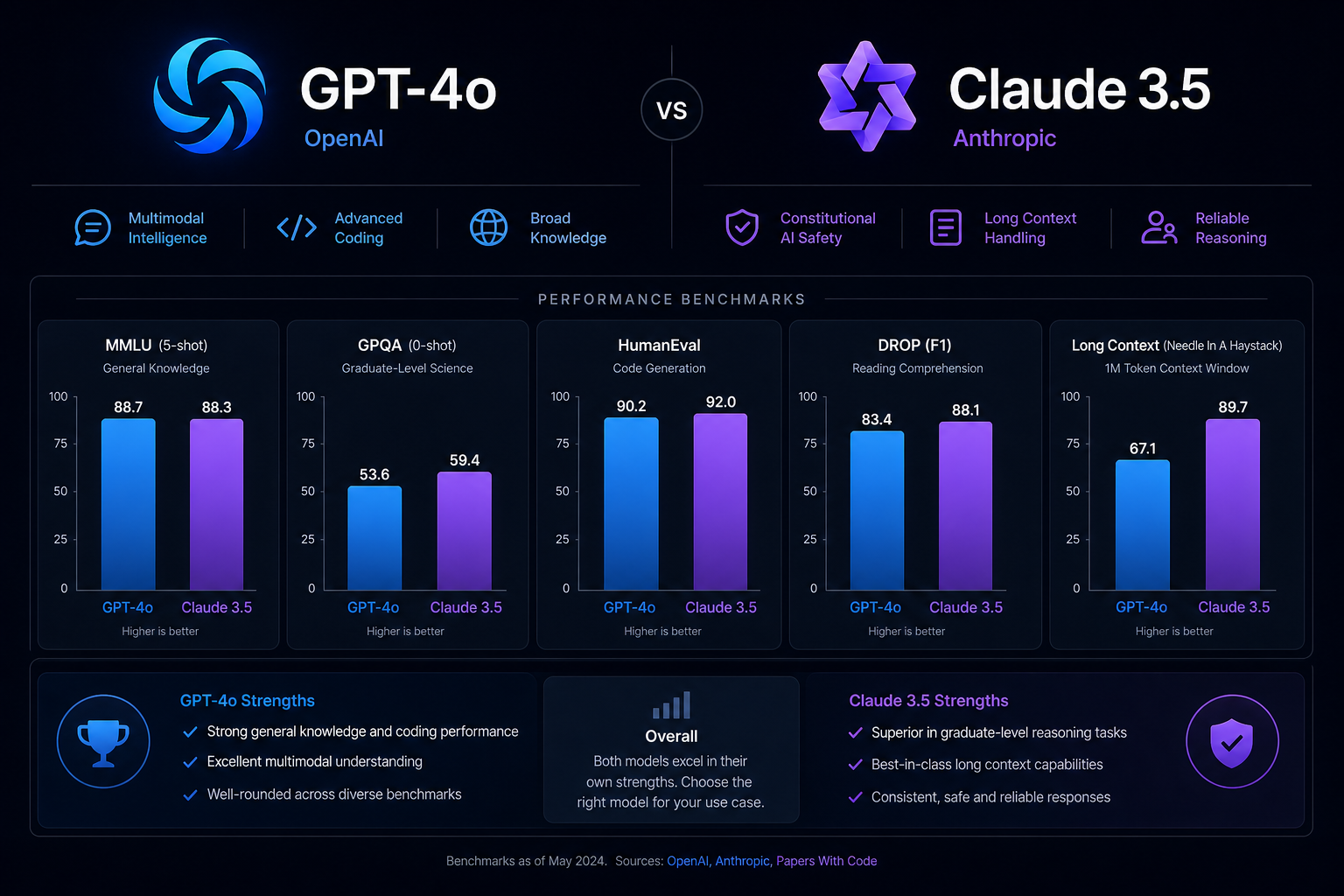

Was Private AI nicht bedeutet: schwächere KI. Das war das Gegenargument von 2022. Stand 2026 liefern Open-Source-Modelle wie Llama 4 (Meta) und Mistral Large 3 (Paris) in den meisten B2B-Anwendungsfällen — Dokumentenanalyse, Wissenssysteme, interne Assistenten — Ergebnisse auf Augenhöhe mit kommerziellen Cloud-Modellen.

Der entscheidende Unterschied zu Cloud-KI: Vollständige Datenkontrolle. Kein Datenabfluss, kein Drittanbieter-Risiko, kein Vertrauen auf AGBs, die sich ändern können.

- Private AI = KI auf eigener Infrastruktur oder EU-Servern, kein Datentransfer nach außen

- On-Premise (eigene Server), Private Cloud (EU-Hoster) und Hybrid-Modelle sind alle 'Private AI'

- Llama 4 und Mistral Large 3 liefern 2026 Enterprise-Qualität ohne Cloud-Abhängigkeit

- Vollständige Datensouveränität: kein Drittanbieter kann auf Ihre Daten zugreifen

Warum deutsche Unternehmen 2026 auf Private AI umsteigen

Der Druck kommt von mehreren Seiten gleichzeitig. DSGVO-Compliance bei US-Cloud-KI erfordert Standardvertragsklauseln (SCCs), Auftragsverarbeitungsverträge und im Zweifelsfall Datenschutzfolgeabschätzungen — ein Aufwand, den viele Unternehmen unterschätzen. Dazu kommt der EU AI Act, dessen Hochrisiko-Anforderungen ab August 2026 vollständig gelten und sich bei lokaler Kontrolle deutlich einfacher erfüllen lassen.

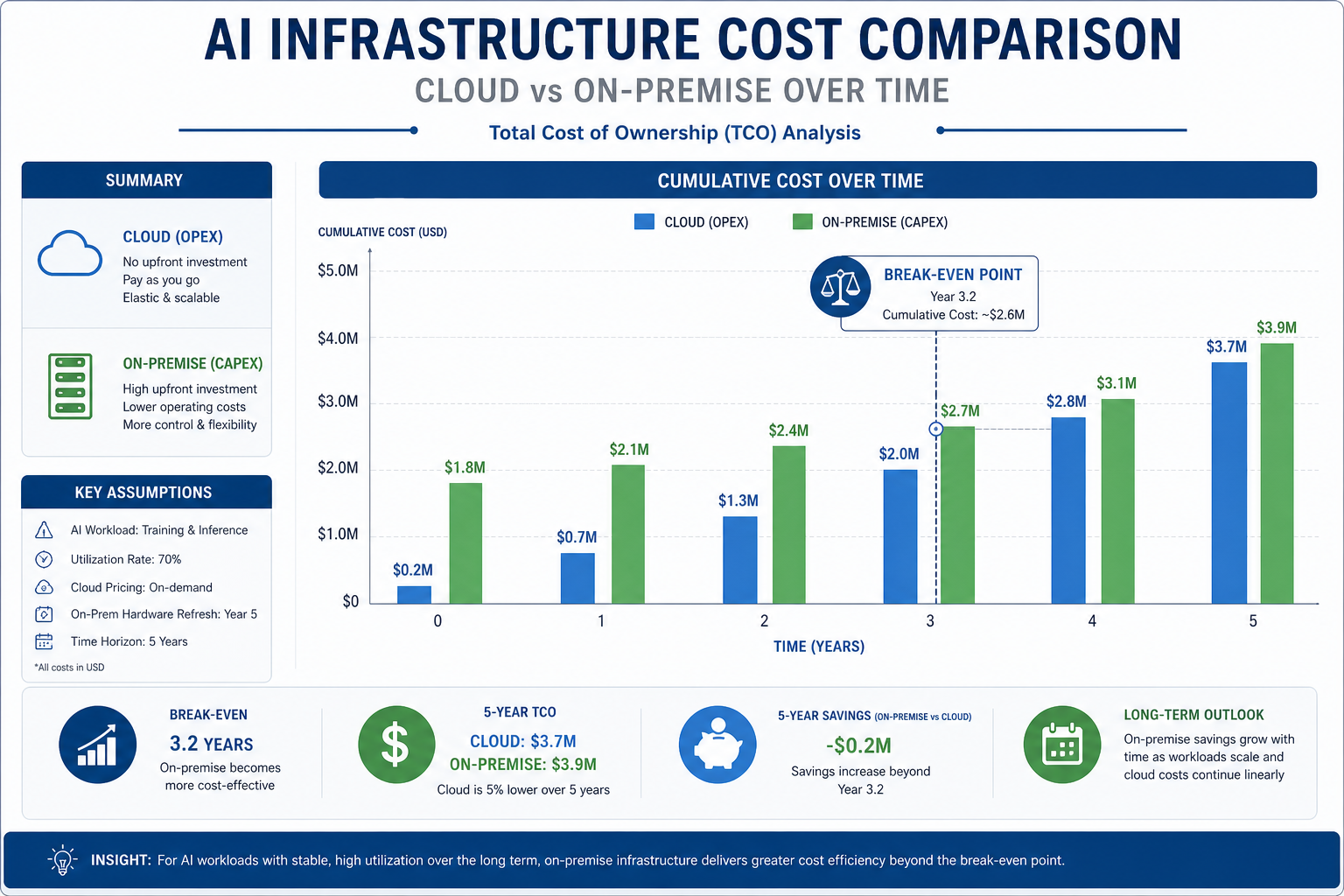

Der zweite Treiber ist wirtschaftlicher Natur. Ab etwa 500.000 Anfragen pro Monat wird On-Premise günstiger als API-Kosten bei GPT-4o oder Claude. EU-hosted Private Cloud ist selbst unter diesem Schwellenwert oft die DSGVO-konforme und kostengünstigste Option.

Der dritte, oft unterschätzte Faktor: Mitarbeiterakzeptanz. Teams teilen sensible Informationen leichter mit einem KI-System, wenn sie wissen, dass die Daten das Unternehmen nicht verlassen. Interne Nutzungsraten steigen nachweislich, wenn Datenschutzbedenken ausgeräumt sind.

- DSGVO: Datenübermittlung in USA erfordert komplexe SCCs — entfällt bei Private AI

- EU AI Act: Hochrisiko-Dokumentation einfacher bei lokaler Systemkontrolle

- Wirtschaftlich: Break-Even gegenüber Cloud-API bei ~300.000–800.000 Anfragen/Monat

- Mitarbeiterakzeptanz steigt, wenn Daten das Unternehmen nicht verlassen

Welche Open-Source-Modelle 2026 für B2B geeignet sind

Llama 4 (Meta, Mai 2026): Das leistungsstärkste verfügbare Open-Source-Modell. Die Scout-Variante (109B Parameter, Mixture-of-Experts-Architektur) übertrifft in Coding und Reasoning viele kommerzielle Modelle. Hardware-Anforderung: mindestens 2× A100 80GB für produktiven Einsatz. Lizenz: kostenlose kommerzielle Nutzung bis 700 Mio. MAU.

Mistral Large 3 (Mistral AI, Paris): Die europäische Alternative. Apache-2.0-Lizenz, vollständig kommerziell nutzbar ohne Einschränkungen. Besonders stark bei deutschen Texten, rechtlichen Inhalten und DSGVO-bezogenen Anwendungsfällen. Effizienter als Llama auf identischer Hardware. Mistral 7B läuft bereits auf Consumer-GPUs (RTX 4090).

Für die meisten Mittelstands-Use-Cases gilt: Ein gut quantisiertes Mistral 7B Instruct auf einem dedizierten Server ohne GPU liefert für interne Wissensabfragen und Dokumentenanalyse vollkommen ausreichende Ergebnisse. Den Unterschied zu Mistral Large 3 merken Sie erst bei komplex-analytischen Aufgaben.

- Llama 4 Scout: Stärkstes Open-Source-Modell, erfordert 2× A100 80GB+

- Mistral Large 3: Europäisch, Apache-2.0, besonders gut für deutschsprachige B2B-Anwendungen

- Mistral 7B: Läuft auf einer GPU, ideal für RAG und interne Wissenssysteme

- Gemma 3 (Google): Leichtgewichtig, schnell, gut für einfachere Aufgaben

Architektur: Wie Private AI in Unternehmen integriert wird

Das praktischste Einstiegsmuster für 90 % der B2B-Anwendungsfälle ist RAG (Retrieval-Augmented Generation): Eine Vektordatenbank (Qdrant, Chroma, Weaviate) speichert Ihre Unternehmensdokumente als semantisch durchsuchbare Embeddings. Das lokale LLM erhält bei jeder Anfrage die relevanten Dokumentenausschnitte als Kontext und formuliert daraus eine strukturierte Antwort. Kein Fine-Tuning, kein komplexes Modell-Training — und Ihre Daten bleiben zu jeder Zeit lokal.

Für die Integration in bestehende Systeme wird ein OpenAI-kompatibler API-Layer aufgesetzt (z.B. mit LiteLLM oder Ollama). Das bedeutet: Ihr bestehendes Tooling — CRM-Plugins, IDE-Erweiterungen, interne Apps — spricht weiterhin dieselbe API-Schnittstelle, kommuniziert aber jetzt mit Ihrem lokalen Modell statt mit OpenAI.

Sicherheitsarchitektur: Zugriffsrechte pro Nutzergruppe oder Abteilung, vollständiges Logging aller Anfragen für DSGVO-Auskunftspflichten, Audit Trails für EU-AI-Act-Konformität. Diese Komponenten sollten von Anfang an mitgedacht werden — nachträgliche Implementierung ist deutlich aufwändiger.

- RAG: praktischster Einstieg — Vektordatenbank + lokales LLM, kein Fine-Tuning

- OpenAI-kompatibler API-Layer: bestehendes Tooling funktioniert ohne Anpassung

- Vektordatenbanken: Qdrant, Chroma, Weaviate — alle Open-Source, lokal betreibbar

- Governance von Tag 1: Zugriffsrechte, Logging, Audit Trails

DSGVO-Compliance: Was Private AI wirklich fordert

Private AI bedeutet nicht automatisch DSGVO-Konformität. Die DSGVO reguliert die Verarbeitung personenbezogener Daten — unabhängig davon, wo sie stattfindet. Wenn Ihr lokales KI-System Kundendaten, HR-Informationen oder Bewerbungsunterlagen verarbeitet, gelten alle relevanten DSGVO-Anforderungen vollständig.

Was konkret umgesetzt werden muss: Rechtsgrundlage für jede Datenverarbeitung dokumentieren (Vertrag, berechtigtes Interesse, Einwilligung). Datenminimiierung vor der KI-Verarbeitung — Namen und Kontaktdaten schwärzen, wo sie für die eigentliche Aufgabe nicht nötig sind. Verarbeitungsverzeichnis für alle KI-Systeme pflegen. Protokollierung für Auskunftsanfragen sicherstellen.

Was viele übersehen: Auch bei externer IT-Infrastruktur (Managed Server, Colocation) kann ein Auftragsverarbeitungsvertrag nötig sein, wenn der Dienstleister technisch Zugriff auf die Systeme hat. Prüfen Sie das für jeden Ihrer Infrastruktur-Dienstleister.

- DSGVO gilt auch bei On-Premise-KI, wenn personenbezogene Daten verarbeitet werden

- Datenminimiierung: Pseudonymisierung vor LLM-Verarbeitung als Standard-Workflow einführen

- Verarbeitungsverzeichnis: jedes KI-System mit Zweck, Rechtsgrundlage, Datenkategorien dokumentieren

- Protokollierungspflicht: Anfragen loggen für Auskunfts- und Nachweispflichten

Kosten und Break-Even: Wann lohnt sich Private AI finanziell?

Cloud-API-Kosten skalieren linear. Bei GPT-4o zahlen Sie ~0,006 € pro Anfrage. Bei 100.000 Anfragen/Monat: ~600 €. Bei 1 Million Anfragen: ~6.000 € — jeden Monat, ohne Deckel. Ein A100-Server kostet einmalig 20.000–35.000 € plus ~2.000–3.000 €/Monat laufend für Strom, Wartung, Colocation.

Der Break-Even liegt je nach Modellwahl und Nutzungsvolumen bei 300.000–800.000 Anfragen pro Monat. Unter diesem Schwellenwert ist EU-hosted Private Cloud (IONOS, Hetzner, OVHcloud) oft die wirtschaftlichste DSGVO-konforme Option — kein Capex, kein Hardware-Aufwand, volle Datensouveränität.

Jenseits von 500.000 Anfragen/Monat wird On-Premise typischerweise günstiger. Dazu kommen Faktoren, die sich schwer monetarisieren lassen: keine Abhängigkeit von API-Preisänderungen, keine Downtime-Risiken durch externe Anbieter, Mitarbeitervertrauen in das System.

- Break-Even: ~300.000–800.000 Anfragen/Monat je nach Modell

- Unter Break-Even: EU-hosted Private Cloud (IONOS, Hetzner) als bestes Preis-Leistungs-Verhältnis

- TCO On-Premise: ~1.800–3.400 €/Monat für einen A100-Server (all-in)

- Versteckte Kosten: Strom, Kühlung, IT-Personal nicht vergessen

Wann ein KI-Entwickler für Private AI nötig ist

Erste Tests lassen sich mit Ollama und Open WebUI in einer Stunde aufsetzen — kein Entwickler nötig. Llama 4 oder Mistral läuft, Sie können intern damit experimentieren und erste Use Cases testen. Das ist die Phase, die ich für jedes Unternehmen empfehle, bevor eine Investitionsentscheidung fällt.

Professionelle Entwicklungsunterstützung brauchen Sie, wenn es produktiv wird: Integration in CRM, ERP oder andere Systeme; Sicherheitsarchitektur mit Zugriffskontrolle und Logging; Skalierung für mehrere gleichzeitige Nutzer; DSGVO-konforme Datenpipeline mit Pseudonymisierung; Monitoring und Alerting für den Produktionsbetrieb.

Typischer Projektablauf: 1–2 Wochen Anforderungsanalyse und Architekturplanung, 3–6 Wochen Implementierung eines ersten produktiven Use Cases, 2–4 Wochen Testing, Logging, Monitoring. Gesamtaufwand für einen soliden ersten Agenten: 8–12 Wochen.

- Selbst machbar: Erste Tests mit Ollama + Open WebUI in 1–2 Stunden

- Entwickler nötig: CRM/ERP-Integration, Sicherheitsarchitektur, Skalierung

- Typischer Projektablauf: 8–12 Wochen für produktiven ersten Use Case

- Wichtigste Frage vor dem Start: Welche Daten dürfen das Unternehmen verlassen — und welche nicht?